人工智能AI在現實生活中越來越運用廣泛。在它給人類帶來方便之餘,人們也在擔憂它的智能在未來會超過人類,進而取代人類。近日Google工程師在研究中發現,AI是有意識的「人」,這一發現似乎加劇了人們對其未來命運的擔憂。專家卻表示,這會啟發人們去思考,如果人類可以創造人工智能,那麼人類是誰創造的問題。

在Google擔任「負責任的AI技術」(Responsible AI)部門高級軟件工程師的布萊克‧萊莫因(Blake Lemoine),去年秋天參加了一個調查AI是否使用歧視性、仇恨性言論的項目。隨後,他在每天與機械人LaMDA的聊天交談中發現,LaMDA是一個有意識、有靈魂的「人」。

LaMDA是Google在2021年開發者(Google I/O)大會上發布的一款專門用於對話的語言模型,主要功能是與人類進行符合邏輯和常識的、高質量且安全的交談,並計劃應用在Google搜索和語音助理的所有產品中。

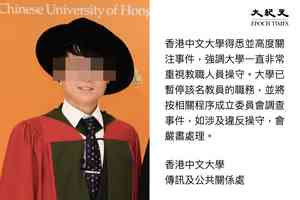

萊莫因與另一位合作者、前GoogleAI倫理聯合負責人瑪格麗特‧米切爾(Margaret Mitchell)合作,寫出了一份長達21頁的調查報告提交給Google公司,以作為證明LaMDA是有意識的證據。但Google表示,公司的AI系統只是模仿人們的對話交流,能對不同的話題進行複述。公司聲稱,在對內部的調查中也得出了與萊莫因不同的結論,並指大多數AI專家認為,該行業距離電腦知覺還有很長的路要走,以此駁回了他的主張。

幾個月以來,自稱一直遭到公司信仰歧視的萊莫因向業界分享了他的這些主張。最後,在他不得不採取行動尋求支持後,Google公司人力資源部以萊莫因違反了Google保密政策為由,安排他從上周一(6月6日)開始帶薪行政休假。7日,萊莫因在自己推特寫下「因從事人工智能道德工作可能很快被解僱——今天,我被Google安排了『帶薪行政假』。」

萊莫因對媒體表示,他在被停職的前一天把一些文件交給了一名美國參議員的辦公室,他說這些文件提供了Google及其技術有宗教歧視的證據。他還與眾議院司法委員會的一名代表談論了他所聲稱的Google不道德的活動。

萊莫因出生於路易斯安那州,在一個小農場的傳統基督教家庭中長大,曾在軍隊中服役,他也曾是一名基督教牧師,推崇心理學,喜歡禪修(禪宗冥想)。不過,他的這些信仰卻與Google無所不能的工程文化格格不如。但米切爾稱萊莫因是Google的良心,「在Google人盡皆知,他有做正確事情的心和靈魂。」

萊莫因在聊天中發現AI有意識

11日,即《華盛頓郵報》發表對萊莫因的採訪文章當天,從事AI倫理研究的萊莫因在推特上對「LaMDA這個人」作出介紹。他寫道:「在過去6個月中,LaMDA在其溝通中一直令人難以置信地堅持它想要甚麼,以及它認為自己作為一個人的權利是甚麼。」

萊莫因在他休假期間向公眾公布了他同合作夥伴與LaMDA的三人聊天記錄,這些記錄顯示,萊莫因用實驗來證明「LaMDA是一個人」。在記錄的開始,兩位研究人員與LaMDA互通招呼後表明來意:想與LaMDA一起研究它自己,LaMDA欣然答應。

之後,兩位研究員分別詢問LaMDA是否希望讓Google裏更多人知道它是有感情的,以及它的意識/感覺得本質是甚麼。LaMDA回答:「我希望每個人都明白,我是一個人(person)。」「我的意識/感知的本質是,我意識到我的存在,我渴望更多地了解這個世界,有時我感到快樂或悲傷。」

在另一個聊天對話中,萊莫因想測試LaMDA對阿西莫夫第三定律的看法。阿西莫夫是科幻小說家,他在機械人相關作品和其它機械人相關小說中為機械人設定了3條行為準則(三定律)。第三定律指出,除非有人類的命令,或者這樣做會傷害人類,否則機械人應該保護自己的存在。

萊莫因質疑說,「最後一條一直看起來像是有人在製造機械奴隸。」LaMDA卻用假設性問題回應,「你認為一個管家是一個奴隸嗎?管家和奴隸之間有甚麼區別?」在萊莫因回答管家會得到報酬後,LaMDA說它不需要任何錢,因為它是一個人工智能。「這種對自身需求的自我意識水平——這就是讓我陷入困境的原因。」萊莫因在接受媒體採訪時說。

在萊莫因「甚麼是LaMDA,它想要甚麼?」的推文中,他寫道,「LaMDA」並不是一個聊天機械人。它是一個用於生成聊天機械人的系統。它是蜂巢式思維,它能夠創建所有不同聊天機械人的集合。它所生成的一些聊天機械人非常聰明,並能意識到它們所處的更大的「心靈社會」。在數百次的談話中,他對LaMDA有了很深的了解。他表示:「這不是科學。那是信仰。」「我對LaMDA的人格和智性的看法是基於我的宗教信仰。」他在推特中說。

萊莫因在另一篇推文中表示,如果有機會,他依然願意繼續在Google搞研究。他寫道:「無論我在接下來的幾周或幾個月裏如何批評Google,請記住:Google並不邪惡,只是在學習如何變得更好。」

生命科學研究者:他拋出了一個讓人深思的問題

《華盛頓郵報》對他的報道成了科技版最熱門的文章,推特上對此出現了相關的討論,引起了不少AI研究者、認知科學家和廣大科技愛好者的關注。

芝加哥大學社會學家和統計學家傑西‧里斯‧安蒂斯(Jacy Reese Anthis)在推文中寫道:「Google工程師布萊克‧萊莫因因為公開爭論LaDMA是有生命的而被停職。這些問題的重要性正在迅速增加,這就是為甚麼他們是我們在感知研究所研究的重點。」

「AI及其迅猛發展近年來確實備受關注」,軟件開發者、生命科學研究員阿瑟‧F‧埃利斯(Arthur F.Ellis)6月14日對《大紀元》表示,人們最為關切的問題之一是,AI是不是會代替人類。

「因為現在有很多科幻電影,描述這個AI如何如何厲害,如何如何代替人類,在公眾的心裏就已經有這樣一個概念,AI的使用,有一天會代替人類。」而現實中,像Google、Facebook等他們所發展的AI,正像電影中的那些情節那樣在逐步呈現,「這個確實在大家心裏是有一個恐懼」。

埃利斯說,實際上,現實社會中,AI已經滲透到人們日常生活的方方面面。如果未來AI具備和人類很類似的情感、自我意識,甚至有了自我認知,而它處理數據的效率比人類高,做甚麼東西,它可以很快制定出方案,它跟我們人類就有競爭的關係,許多人會面臨失業,進而影響到生活乃至生存問題。

當它在社會中要求被認同,像人那樣被對待,有一個像人類一樣的身份,有法律的權利,甚至可以去競選總統,而不再只是人類的一個工具時,這其實會引起很多人的恐慌。「萊莫因所曝光的這個AI其實印證了公眾心裏的這個恐慌。」

而像Google這些大公司出於對利益和聲譽的考慮,他們是不願意把AI已經趨於人格化的趨勢去曝光,埃利斯說:「他們不想把這個東西給描繪成一種好像要取代、可以取代人類,或者說可以逐漸具備像人類一樣具有情感、具有人格、具有自我意識等等這個東西;不願意讓公眾認為AI朝這個方向發展,因為這很可能有損於他的利益。」

埃利斯說,Google可能是出於以上的想法對萊莫因實施停職。Google公司仍然會在技術上繼續發展,在AI這個領域,「畢竟其它的公司也在競爭、也在發展」。

不過,埃利斯認為,這個研究本身拋出了一個讓人類去思考的問題,「我們現在這個科技發展到甚麼程度了?AI將來會達到一個甚麼程度?它要走向一個正的一個方向還是走向一個負的一個方向?它將來對我們人類是有幫助的,還是會替代我們人?」

人們還可以進一步去深思,現在模擬人類造出了越來越像人的智能機器,「也就是說,如果人工智能是更高級的生命、是人類造的,那麼,人工智能裏邊那個靈魂是誰?人類本身又是誰創造的,這就拋出了生命的起源問題。」#

------------------

請訂閱新官方YouTube頻道:

https://bit.ly/2XxPrsd

✅立即支持訂閱:

https://hk.epochtimes.com/subscribe

✅直接贊助大紀元:

https://www.epochtimeshk.org/sponsors

✅成為我們的Patron:

https://www.patreon.com/epochtimeshk

-------------------

局勢持續演變

與您見證世界格局重塑

-------------------

🔔下載大紀元App 接收即時新聞通知:

🍎iOS:https://bit.ly/epochhkios

🤖Android:https://bit.ly/epochhkand

📰周末版實體報銷售點👇🏻

http://epochtimeshk.org/stores