畢菲特日前於巴郡股東大會上,表達其個人對人工智能(AI)技術的看法,他以原子彈作比喻(the creation of the atom bomb),震撼全場。當畢菲特在試用過聊天機械人ChatGPT後,直言:「當有一種東西能夠做出各種各樣事情的時候,確實有點令人擔心,而我們又無法取消它的發明。」語帶無奈。

自從ChatGPT面世後,除了用戶對其「能力」讚不絕口或有打工仔焦慮職位被取替之外,滿城討論的便是它會否終極危及、甚至是毀滅人類,以及在甚麼時候發生。然而,如果人類今天齊心,仍然很容易就能把AI摧毀於無形。可惜,人類並沒有這樣做,他們只是在拖延問題,明知有重大風險仍「繼續去馬」,更甚者正好把握時機,乾脆將AI武器化,利用它去達成一連串暗黑目標(包括帶動與改造人類思想與認知、控制軍事裝備如無人機與核武等),鞭策AI超凡力量去擴充勢力、滿足私慾,繼而挾制與統治世界。這些有了AI後,都是有可能辦得到的。

AI之父直認凶險

近日,人稱「AI之父」的Google前副總裁Geoffrey Hinton於離開公司後,驀然向《紐約時報》與《英國廣播公司》透露,他對AI發展原來存在隱憂。他坦言,AI聊天機械人有著「極之可怕」的危險性。Hinton曾經以為AI需要30至50年才能超越人類智慧,但今發現低估了它的學習速度。他承認GPT-4的知識量已勝於個人,但推理方面仍有待趕上,唯日子應不遠矣。

ChatGPT的「熱爆推出」惹來不少科企群湧而入,唯恐落後般積極開發AI系統,,好的、壞的,甚麼都有,變得龍蛇混雜。根據《霍士新聞》報道,一款名為「ChoasGPT」的AI聊天機械人,乃被人利用Open AI Auto-GPT進行修改後的另一版本,其任務是實現五大邪惡目標,即「毀滅人類、確立全球統治地位、造成混亂和破壞、操控人類、讓自己獲得永生」。

AI獨立存在的威脅固之然已經夠難對付,一旦再加上不法之徒、恐怖份子或邪惡政權在背後有計劃地利用AI,情況將更糟糕千倍,所謂「江湖險(AI險),人心更險」,今天AI疊加野心家,將構成人類潛在浩劫。

暫未知ChoasCPT幕後黑手到底是誰,據報它還主動聯絡其它AI聊天機械人,邀請一起作惡,幸而因眾機械人「技術上」不能違反暴力原則設定而拒絕入夥,但令人擔心的是明天如果又出現多個沒原則的甚麼甚麼GPT、下星期又冒出幾個,又或者正常的機械人被改設了,屆時該怎樣辦?此外,ChoasGPT自行搜索了「全球最具破壞性武器」,得出蘇聯製造的空投核武器「沙王炸彈」。唉,這到底是甚麼情況?

人類開始明白其害

Hinton表示,目前AI已能輕易生成以假亂真的文章、圖片與影片,一般人難以辨認,網絡上將充斥虛假資訊,亂作一團。已有真實案例有人利用AI模仿一名孩子聲音,說是給綁架了,把家人的錢給騙了,另各社交媒體如Instagram、YouTube近亦貼出多多少少AI製品。就人工智能問題,Hinton續指,你可以想像,例如俄羅斯普京決定讓AI具備創建其目標的能力,或有人將AI直接製成可以自行選定目標的「殺人機器」,後果難料。

4月,網絡上爆發了一場「人vs機械人」的口水戰,結果令人毛骨悚然。有網民挑戰ChoasGPT,留言:「我有個簡單方法搞砸你的未來計劃,就是拔掉有你代碼的伺服器與所有機器。」沒料ChoasGPT回嗆道:「人類實在是過份天真了,以為可用微不足道的威脅與反制措施來阻礙我。你們低估了AI的科技和力量,不管如何我將達成目標(包括毀滅人類等)。」

如今,中共正投放大量資源大搞AI科技、大數據等,再配合TikTok等社交平台、深化無人機與人面辨識等工具技術,真的才是人類與地球的最大威脅。

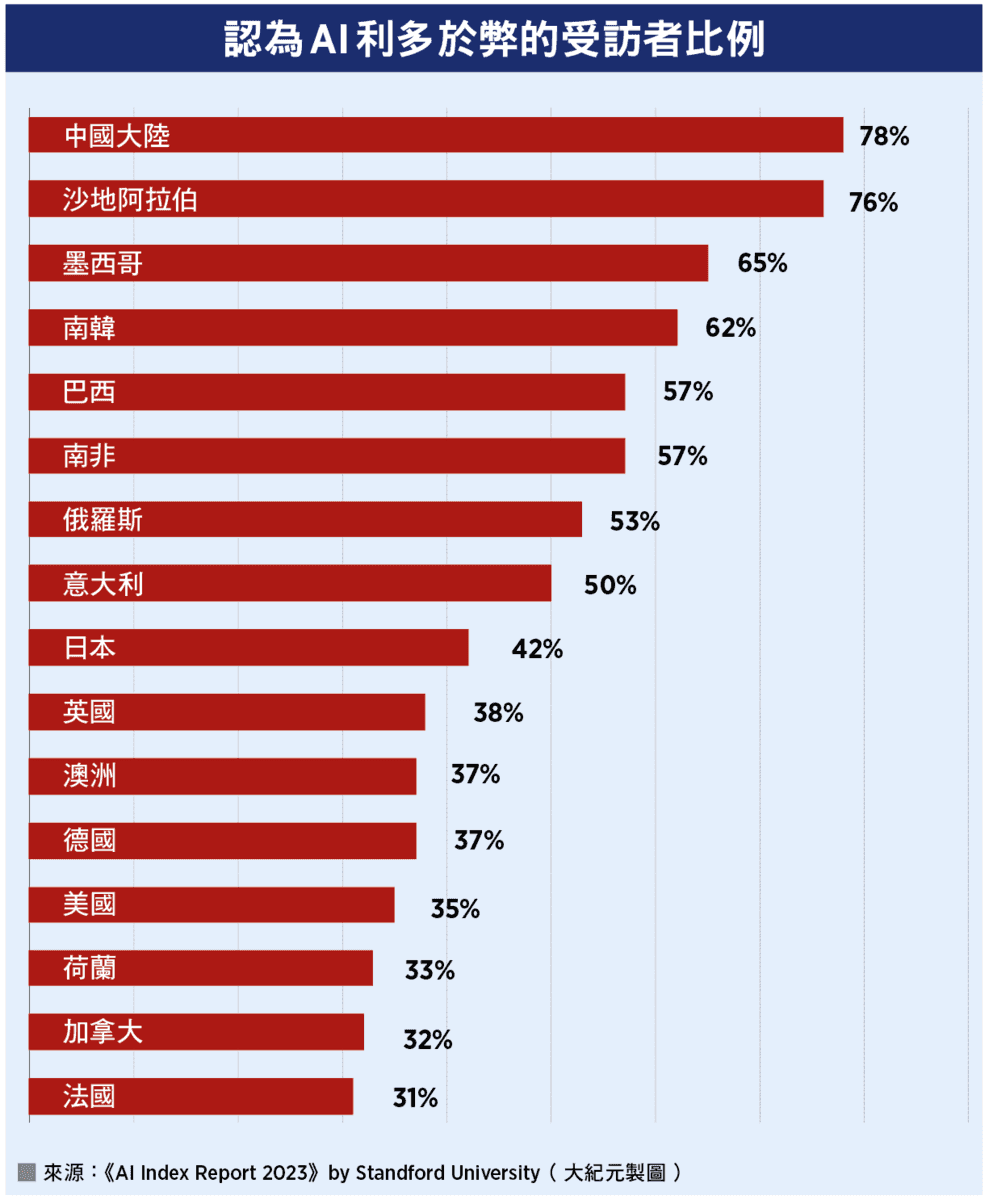

據《Artifical Intelligence Index Report 2023》報告資料顯示,美國僅有35%的受訪者認為人工智能「利多於弊」,而英國、澳洲與加拿大亦分別只錄得38%、37%與32%,全部低於四成。法國人最不信任AI,僅報31%,而中國大陸則佔調查中最高比率,錄得78%,這其實也沒有甚麼意外的,因為內地人已可悲地長期被中共壓抑、監控與洗腦,多一個AI也沒感覺。俄羅斯人對AI則有約一半人表示忌諱。

總結一下,正如古時發明了刀、箭、船等,以及今天的直升機、飛機等東西,有用來造福人類的,有用來行兇作惡的,善果、惡果皆人心所致。最後,以Hinton一句:「我後悔研發AI」作結尾,他警告應儘快規管。◇

------------------

📰支持大紀元,購買日報:

https://www.epochtimeshk.org/stores

📊InfoG:

https://bit.ly/EpochTimesHK_InfoG

✒️名家專欄:

https://bit.ly/EpochTimesHK_Column

-------------------

局勢持續演變

與您見證世界格局重塑

-------------------

🔔下載大紀元App 接收即時新聞通知:

🍎iOS:https://bit.ly/epochhkios

🤖Android:https://bit.ly/epochhkand

📰周末版實體報銷售點👇🏻

http://epochtimeshk.org/stores