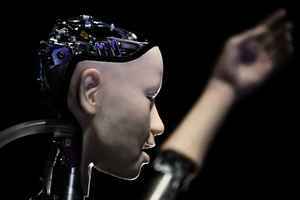

人工智能開發領域的一位領軍人物警告說,人工智能已經發展出初級的推理能力,並可能尋求推翻人類。

多倫多大學電腦科學教授辛頓說,人工智能系統可能會發展出從人類手中奪取控制權的願望,作為它們實現其它預編程序目標的一種方式。

6月28日,辛頓在加拿大多倫多舉行的碰撞技術大會(Collision tech conference)上發言時說,「我認為我們必須認真對待這種可能性,如果它們變得比我們更聰明(這似乎很有可能),而且它們有自己的追求(這似乎很有可能),它們很可能會發展出奪取控制權的追求。」

「如果它們這麼做,我們就有麻煩了。」

辛頓因其在神經網絡方面的成就而被稱為「人工智能教父」之一。他最近花了十年時間幫助Google開發人工智能系統,但在上個月離開了該公司,說他需要能夠警告人們人工智能帶來的風險。

雖然辛頓不認為人工智能天生渴望權力,但他說,它仍然可以尋求從人類手中奪取權力,作為一個合乎邏輯的步驟,以更好地實現自己的目標。

辛頓問道,「總體上說,如果有某種東西比你聰明得多,非常擅長操縱人,而且達到了非常普遍的程度,你有信心讓人們保持掌控嗎?」

他說,「我認為它們會衍生出(奪取控制權的動機),作為實現其它目標的一種方式。」

人工智能現在具有推理能力

辛頓曾經懷疑,在未來30到50年內能否出現一個能與人類相媲美的超級人工智能(AI superintelligence)。他現在認為,它可能在不到20年內就會出現。

他說,部份原因在於,使用大型語言模型的人工智能

他說,「其大型語言模型正在接近(我們),我真的弄不明白它們是怎麼做到的,它們可以做一些小的推理。」

「它們仍然無法與我們匹敵,但是它們已經很接近了。」

辛頓描述了一個人工智能系統:該系統接到了一個難題,必須計劃如何粉刷一個房子的幾個房間。它有三種顏色可選擇,其中一種顏色會隨著時間的推移而褪色,成為另一種顏色。它被要求在規定的時間內將一定數量的房間塗成特定的顏色,結果,人工智能沒有僅僅選擇將房間刷成所需的顏色,還決定不去粉刷那些它知道最終會褪色成所需顏色的房間,來選擇節省資源,儘管它並沒有被編程去這樣做。

辛頓說,「這就是思考。」

為此,辛頓說,沒有理由懷疑人工智能在未來幾年內不會達到,甚至超過人類的智力。

辛頓說,「我們就是一個大的神經網,沒有理由否認人工神經網能做我們能做的一切。」

「我們正在進入一個巨大的充滿不確定性的時期。沒有人真正知道會發生甚麼。」

戰爭機械人將破壞世界的穩定

人工智能甚至可能不需要達到超級智能,就能對人類生存構成風險。

辛頓說,世界各地的軍隊正在為進行戰爭製造人工智能機械人,這些機械人可能會尋求控制權以完成其被編程的任務,或者尋求通過挑起更多衝突來擾亂政治秩序。

辛頓說,「它們是致命的自主武器,值得我們深思。」

他說,「即使人工智能不是超級智能,但是如果國防部門用它來製造戰鬥機械人,那也將是非常糟糕、令人恐懼的事情。」

在那些尋求開發致命性人工智能的國家中,最重要的莫過於世界上最大的兩個軍事強國:中國和美國。

目前中共政權正在開發具有人工智能功能的致命系統,同時投資於與軍事決策、指揮和控制有關的人工智能能力。

與此同時,美國正在為未來做準備,屆時世界各國的軍隊主要由機械人組成,高層預計這種情況在15年之內就會發生。

辛頓說,「我們知道他們將製造戰鬥機械人,他們正忙於在許多不同的國防部門做這件事,所以(機械人)不一定是好東西,因為它們的主要目的是殺人。」

此外,辛頓建議,由人工智能驅動的致命性自主系統一旦出現,將從根本上改變地緣政治結構,大幅降低那些有能力負擔此類系統的國家的政治和人力成本。

辛頓說,「即使它不是超級智能,沒有自己的意圖……它也將使,例如,富國入侵窮國,變得更加容易。」

「目前,無可奈何的是,入侵窮國都有一個障礙,那就是你的公民會死在戰場上;如果死去的只是戰鬥機械人,那真是太好了,軍工企業會喜歡這樣。」

為此,辛頓表示,政府應該鼓勵人們更多地研究如何保護人類免受人工智能的侵害。簡而言之,他說,很多人都在努力改進人工智能,但很少有人研究如何讓它變得更安全。

他說,最好的辦法是建立國際規則,禁止、限制開發人工智能武器系統,就像在第一次世界大戰後《日內瓦議定書》對化學戰所做限制那樣。

辛頓說,「類似於《日內瓦公約》(Geneva Convention)這樣的東西固然很了不起,但是,這些東西總是在災難發生後才會出現。」

他強調,無論政府在人工智能方面會不會採取甚麼行動,人們都必須意識到正在開發的人工智能正在給人類帶來威脅。

辛頓說,「我認為重要的是,人們要明白,這可不只是科幻小說,也不僅僅是散布恐懼,而是一個我們需要思考的真實存在的風險,我們需要提前想好如何應對。」#

原文:Godfather of AI’ Speaks Out: AI Capable of Reason, May Seek Control刊登於英文《大紀元時報》。

------------------

📰支持大紀元,購買日報:

https://www.epochtimeshk.org/stores

📊InfoG:

https://bit.ly/EpochTimesHK_InfoG

✒️名家專欄:

https://bit.ly/EpochTimesHK_Column

-------------------

局勢持續演變

與您見證世界格局重塑

-------------------

🔔下載大紀元App 接收即時新聞通知:

🍎iOS:https://bit.ly/epochhkios

🤖Android:https://bit.ly/epochhkand

📰周末版實體報銷售點👇🏻

http://epochtimeshk.org/stores